Dynamikbereich bei Bildverarbeitungssensoren

In der industriellen Bildverarbeitung besteht die eigentliche Herausforderung selten darin, ausreichend Licht einzufangen, sondern darin, extreme Kontraste zu bewältigen. Wenn Sie einen stark reflektierenden, gefrästen Aluminiumzylinder mit einem matten schwarzen Gummi-O-Ring inspizieren, muss Ihre Kamera grelle Glanzlichter und tiefe Schatten gleichzeitig verarbeiten. Der Dynamikbereich beschreibt genau diese Fähigkeit - ohne dass helle Details zu reinem Weiß ausreißen oder dunkle Details im Bildrauschen versinken. Wer die Physik des Dynamikbereichs versteht, kann die richtige Sensorarchitektur für kontrastreiche Umgebungen wie Schweißinspektion, Halbleiterfertigung oder Outdoor-Verkehrsüberwachung gezielt auswählen.

Die Physik des Dynamikbereichs: Eimer und Rauschen

Um den Dynamikbereich zu verstehen, hilft es, sich ein einzelnes Pixel als Eimer vorzustellen, der Regen (Photonen) auffängt.

Die maximale Wassermenge, die der Eimer aufnehmen kann, bevor er überläuft, ist die Full-Well-Kapazität (FWC) des Pixels. Sammelt das Pixel mehr Photonen als seine FWC, sättigt es. Die Bilddaten werden dann auf reines Weiß abgeschnitten, und alle geometrischen Details in diesem hellen Bereich gehen unwiderruflich verloren.

Allerdings ist der Eimer nie ganz sauber. Selbst in absoluter Dunkelheit erzeugt die Sensorelektronik ein elektrisches Grundrauschen, bekannt als Ausleserauschen. Dieses Rauschen wirkt wie eine Schicht trüber Ablagerung am Boden des Eimers. Jedes einfallende Lichtsignal, das schwächer ist als dieses Grundrauschen, lässt sich nicht zuverlässig messen.

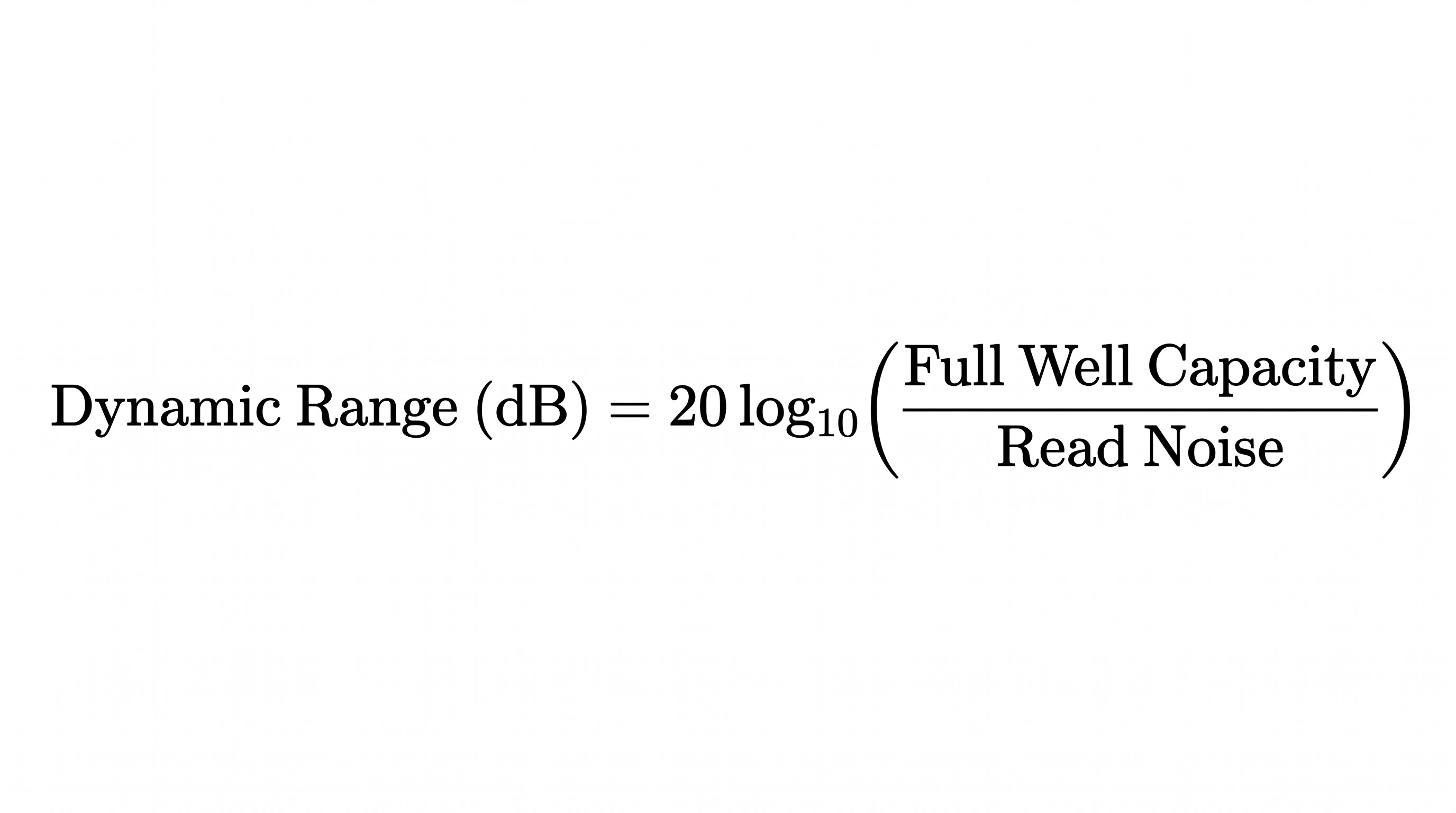

Der Dynamikbereich eines Sensors ist der nutzbare Bereich zwischen diesem Grundrauschen und dem Sättigungspunkt. Er wird mathematisch als Verhältnis berechnet und in Dezibel (dB) angegeben:

Um den Dynamikbereich zu vergrößern, müssen Sensorhersteller entweder einen größeren Eimer (höhere Full-Well-Kapazität) konstruieren oder die Ablagerung am Boden (geringeres Ausleserauschen) reduzieren.

Um den Dynamikbereich zu vergrößern, müssen Sensorhersteller entweder einen größeren Eimer (höhere Full-Well-Kapazität) konstruieren oder die Ablagerung am Boden (geringeres Ausleserauschen) reduzieren.

Dynamikbereich vs. Bittiefe: Die Lineal-Analogie

Ingenieure verwechseln häufig den Dynamikbereich einer Kamera mit ihrer Bittiefe (z. B. 8-Bit- vs. 12-Bit-Ausgang). Die beiden Werte messen jedoch völlig unterschiedliche Dinge.

Stellen Sie sich den Dynamikbereich als die gesamte physische Länge eines Lineals vor. Er definiert den absoluten Abstand zwischen dem dunkelsten Schatten und dem hellsten Glanzlicht. Die Bittiefe entspricht der Anzahl der Skalenstriche auf diesem Lineal.

Ein 8-Bit-Ausgang teilt das Lineal in 256 unterschiedliche Graustufen, ein 12-Bit-Ausgang teilt dasselbe Lineal in 4.096 Stufen. Der Wechsel von einem 8-Bit- auf ein 12-Bit-Format vergrößert nicht plötzlich den physischen Dynamikbereich des Sensors - er liefert der Bildverarbeitungssoftware lediglich feinere, weichere Übergänge zwischen den absoluten Schwarz- und Weiß-Grenzen.

Wie Industriekameras High Dynamic Range (HDR) erreichen

Wenn die Standard-Sensorphysik den Kontrastumfang einer Anwendung nicht abdeckt, setzen Kamerahersteller bestimmte Hardware- und Software-Techniken ein, um den Dynamikbereich zu erweitern.

|

HDR-Technik |

Funktionsweise |

Am besten geeignet für |

|

Großes Pixelraster |

Physisch größere Pixel besitzen von Natur aus eine sehr hohe Full-Well-Kapazität und können extreme Glanzlichter aufnehmen, ohne zu sättigen - bei gleichzeitig niedrigem Rauschen. |

Schnelle, kontrastreiche Inspektion, bei der Bewegungsartefakte vollständig vermieden werden müssen. |

|

Multi-Exposure-HDR |

Die Kamera erfasst in schneller Folge zwei Bilder - ein kurz belichtetes für die Glanzlichter und ein lang belichtetes für die Schatten - und führt sie in Hardware zusammen. |

Stationäre Teile oder Outdoor-ITS (Intelligente Verkehrssysteme), bei denen das Ziel relativ vorhersehbar ist. |

|

Dual Conversion Gain (DCG) |

Der Sensor verfügt pro Pixel über zwei separate Ausleseschaltungen mit unterschiedlichen Verstärkungsstufen und kombiniert hohe Verstärkung (geringes Rauschen) und niedrige Verstärkung (hohe Sättigung) simultan. |

Hochdynamische Umgebungen, in denen Single-Frame-HDR ohne räumliche Verzerrung gefordert ist. |

Dynamikbereich mit optischen Lösungen managen

Ist ein Kamera-Upgrade nicht möglich, lösen Systemintegratoren Dynamikbereich-Probleme oft mechanisch, bevor das Licht überhaupt den Sensor erreicht. Polarisierte Lichtquellen in Kombination mit Polarisationsfiltern am Objektiv können Reflexionen auf metallischen oder Kunststoffoberflächen drastisch reduzieren. So wird die Spitzenhelligkeit der Szene künstlich abgesenkt und der Kontrast in einen Bereich komprimiert, den ein Standard-Bildverarbeitungssensor problemlos messen kann.

Häufig gestellte Fragen

Ja. Da der Sensor für ein einzelnes HDR-Bild mehrere Frames physikalisch belichten, auslesen und mathematisch zusammenführen muss, sinkt Ihre maximal erreichbare Bildrate spürbar. Außerdem entsteht das Risiko von "Ghosting"-Artefakten, wenn sich das Prüfteil zwischen erster und zweiter Belichtung schnell bewegt.

Ein kürzeres Belichtungszeit verhindert zwar, dass helle Bildbereiche zu reinem Weiß abreißen, verschiebt aber Ihr gesamtes Belichtungsfenster nach unten. Das bedeutet, dass die Schatten unter das Grundrauschen fallen und tiefschwarz werden. Der Dynamikbereich wird dadurch nicht erhöht - Sie müssen lediglich entscheiden, welches Ende des Lichtspektrums Sie opfern wollen.

Industrielle Standard-CMOS-Sensoren bieten typischerweise einen Dynamikbereich zwischen 60 dB und 75 dB. Das ist mehr als ausreichend für klassische Fabrikautomation mit kontrollierter Beleuchtung. Hochspezialisierte HDR-Sensoren für Schweißanwendungen oder Outdoor-Automotive-Szenarien können deutlich über 90 dB oder sogar 120 dB hinausgehen.